Retour à la table des matières

Revue Droits et libertés, printemps / été 2022

Anne Pineau, militante au comité surveillance des populations, IA et droits humains de la LDL

La protection des renseignements personnels (RP) fait partie intégrante du droit à la vie privée reconnu par les chartes des droits. Il assure le contrôle des individus sur leurs données et leur droit « de déterminer eux-mêmes à quel moment les renseignements les concernant sont communiqués, de quelle manière et dans quelle mesure1 ».

Les lois de protection des RP adoptées dans les années 80 et 90 posent les principes de cette protection : consentement de la personne concernée (PC) à la cueillette de ses RP; minimisation de la collecte aux seuls RP nécessaires; respect des finalités et destruction des données après réalisations des fins; sécurisation et confidentialité des RP; accès de la PC à ses données.

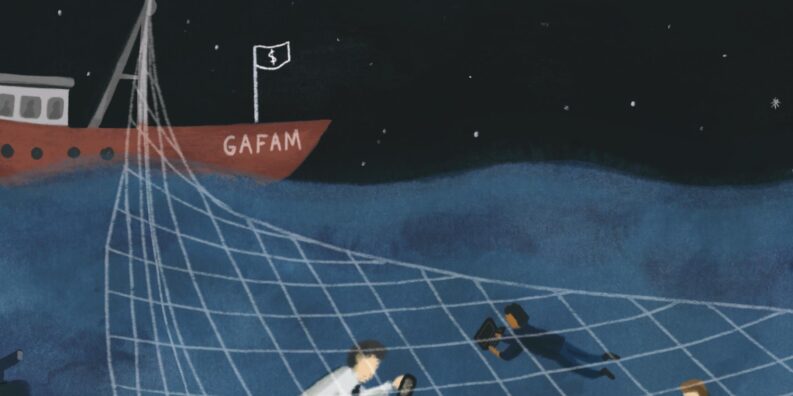

Mais le développement fulgurant de l’informatique, des réseaux sociaux et de l’intelligence artificielle ont fait naître d’autres enjeux et rendu ces lois en partie obsolètes. Une sérieuse mise à jour s’imposait, particulièrement pour contrecarrer l’accumulation effrénée de données par les plateformes numériques (GAFAM), à des fins publicitaires, politiques ou autres.

La réponse du gouvernement québécois a consisté dans le dépôt du Projet de loi 64 (PL 64)2, modifiant tant la Loi sur l’accès aux documents des organismes publics et sur la protection des renseignements personnels (LAI)3 que la Loi sur la protection des RP dans le secteur privée4. Largement inspiré du Règlement général sur la protection des données (RGPD) du Parlement européen, le PL 64 apporte plusieurs correctifs comme celle de la notion de RP qui est élargie ; elle s’étend aux informations permettant d’identifier une personne physique, directement ou indirectement. Les exigences sont aussi resserrées en matière de consentement (qui doit être manifeste, libre, éclairé, donné à des fins spécifiques et distinctement pour chacune des fins); mais du même souffle le PL 64 multiplie les cas où les RP pourront être utilisés ou transmis sans consentement.

De plus, tout produit ou service technologique disposant de paramètres de confidentialité devra, par défaut, assurer le plus haut niveau de confidentialité; mais cette obligation ne s’applique pas aux témoins de connexion (cookies). Lors de la collecte de RP, les fonctions d’identification, de localisation ou de profilage qu’une entreprise ou un organisme public (OP) utilise éventuellement devront être désactivées par défaut; ces fonctions devront donc être activées par la PC, si elle y consent. Ensuite, toute personne qui fait l’objet d’une décision « fondée exclusivement sur un traitement automatisé » doit être informée de ce fait, de même que des RP et des principaux facteurs utilisés pour rendre la décision; contrairement au RGPD, il ne sera pas possible de s’opposer au traitement entièrement automatisé d’une décision.

Un élément important à souligner est la perte du pouvoir de contrôle de la Commission d’accès à l’information (CAI) en matière de Recherche; la communication de RP à cette fin sera possible sur simple Évaluation des facteurs relatifs à la vie privée (EFVP), une sorte d’étude d’impact maison menée par l’entreprise ou l’organisme; on passe donc d’un régime d’autorisation (par un tiers indépendant) à un système d’autorégulation. Le tout pour la communication sans consentement de RP possiblement très sensible.

Du côté du secteur privé, les entreprises ou OP ont le droit de conserver et d’utiliser les RP, sans consentement, lorsque les fins pour lesquelles ils ont été recueillis sont accomplies, à condition de les anonymiser ; ce qui est contraire au principe de base de la destruction des RP après réalisation des fins. Cela est d’autant plus inadmissible que l’anonymisation est un procédé qui n’est pas infaillible.

Les entreprises et OP ont aussi l’obligation d’aviser les personnes touchées par un bris de confidentialité lorsque l’incident présente un risque de préjudice sérieux; la personne n’a cependant pas à être avisée tant que cela serait susceptible d’entraver une enquête policière et comme ces enquêtes peuvent être longues, les victimes pourraient très bien être avisées du vol de leurs données longtemps après le fait.

Notons une augmentation importante des sanctions pénales en cas de contravention à la loi par une entreprise (amende maximale de 25M$ ou 4 % du chiffre d’affaires mondial.) La CAI se voit accorder un pouvoir de sanction administrative (montant maximal de sanction pour une entreprise pouvant atteindre 10M$ ou 2 % du chiffre d’affaires mondial). L’entreprise pourra toutefois s’engager auprès de la CAI à prendre les mesures nécessaires pour remédier au manquement, auquel cas elle ne pourra faire l’objet d’une sanction administrative.

Ces dispositions entreront en vigueur graduellement d’ici 2024. Si on peut noter quelques avancées intéressantes, le PL 64 comporte aussi plusieurs reculs; et ces modifications législatives s’avèrent nettement insuffisantes pour répondre aux enjeux actuels.

Le PL 64 laisse en plan plusieurs questions. La biométrie, notamment l’utilisation de la reconnaissance faciale, est ignorée5. Pourtant un contrôle accru de cette technologie s’imposait au vu des affaires Clearview AI6 et du Centre commercial Place Ste-Foy7. La CAI faisait d’ailleurs valoir dans son mémoire sur le PL 64 que « la législation actuelle ne permet pas d’encadrer adéquatement certaines utilisations de cette technologie8 ».

Si la désactivation par défaut de certains outils de traçage doit être saluée, on peut toutefois craindre que l’inactivation de ces outils affecte délibérément le fonctionnement ou la qualité du service ou du produit technologique.

Par ailleurs, le traitement de données massives par intelligence artificielle soulève des enjeux sociétaux. L’édiction de règles de transparence et d’explication des modes de fonctionnement de ces systèmes est essentielle.

Les algorithmes de personnalisation peuvent conduire les individus à s’enfermer dans leurs certitudes et miner la capacité de mener des débats publics éclairés. Les chambres d’écho des réseaux sociaux peuvent, quant à elles, amoindrir la circulation de l’information et la diversité d’opinions et mener à de la manipulation. En outre, des algorithmes mal calibrés peuvent entretenir – voire aggraver – des pratiques discriminatoires. De nombreux cas prouvent que des vices de conception ou l’usage de données historiquement biaisées peuvent conduire l’algorithme à reproduire, voire aggraver, des attitudes et des comportements discriminatoires. La LDL réclamait une divulgation publique et proactive du mode de fonctionnement de ces systèmes et leur surveillance par audit indépendant. Le PL 64 ne répond pas à ces préoccupations.

Le PL 64 ne révolutionne rien. Il conforte un modèle d’affaires fondé sur l’extraction de données et l’accaparement des traces numériques que nous laissons derrière nous. En y mettant toutefois quelques formes, du côté du consentement. Pas de quoi limiter ou proscrire la logique d’accumulation de données comportementales ni rameuter les troupes de lobbyistes à l’emploi des GAFAM.

Nous sommes ici à des lieux de ce que Shoshana Zuboff appelle de ses vœux, à savoir, des « lois qui rejettent la légitimité fondamentale des déclarations du capitalisme de surveillance et qui mettent fin à ses opérations les plus primaires, y compris la restitution illégitime de l’expérience humaine sous forme de données comportementales9 ».

- R. c. Spencer, 2014 CSC 43, 2 RCS 212, par. 40.

- Maintenant adopté sous le nom de chapitre 25 (Loi 25) des lois de

- Loi sur l’accès aux documents des organismes publics et sur la protection des renseignements personnels, chapitre A-2.1 (LAI)

- Loi sur la protection des renseignements personnels dans le secteur privé (Loi privée), chapitre P-39.1

- Sauf en ce qui concerne le préavis, à la CAI, de constitution d’une banque de données biométriques.

- En ligne : https://www.cai.gouv.qc.ca/la-commission-ordonne-clearview-ai-de-cesser-ses-pratiques-de-reconnaissance-faciale-non-conformes/

- En ligne : https://www.journaldequebec.com/2020/10/31/ivanhoe-cambridge-a-abandonne-lidee

- En ligne : https://wcai.gouv.qc.ca/documents/CAI_M_projet_loi_64_ modernisation_PRP.pdf

- Shoshana Zuboff, L’âge du capitalisme de surveillance, Zulma, 2020, p. 463.