Retour à la table des matières

Revue Droits et libertés, printemps / été 2022

Silviana Cocan, docteure en droit, chargée de cours et chercheuse postdoctorale, Faculté de droit, UdM et militante au comité surveillance des populations, IA et droits humains de la LDL

L’émergence du capitalisme de surveillance est étroitement liée aux progrès technologiques, notamment dans le domaine du numérique, qui n’ont pas été anticipés par le droit international des droits de la personne. Le cadre juridique international protège principalement le droit à la vie privée et avait vocation initialement à imposer à la charge des États des obligations internationales de protection, sans toutefois prendre en considération le rôle joué par les entreprises privées. Ainsi, l’article 12 de la Déclaration universelle des droits de l’homme (1948) et l’article 17 du Pacte international relatif aux droits civils et politiques (1966) soulignent l’interdiction des « immixtions arbitraires ou illégales dans sa vie privée, sa famille, son domicile ou sa correspondance [et des] atteintes illégales à son honneur et à sa réputation ». Ces dispositions consacrent également le droit de toute personne à « la protection de la loi contre de telles immixtions ou de telles atteintes ».

Néanmoins, la protection de la vie privée et des données personnelles dans l’espace numérique exploité par des entreprises privées, qui échappent au contrôle étatique, soulèvent de nombreux enjeux. Le droit international des droits de la personne s’adresse en premier lieu aux États et à leurs organes, qui sont tenus de s’y conformer et de veiller à ce que des tiers ne portent pas atteinte aux droits et libertés garantis.

Il est vrai que dans les Principes directeurs relatifs aux entreprises et aux droits de l’homme (2011), les Nations Unies avaient souligné que les entreprises étaient tenues de respecter les droits de la personne, de minimiser les incidences négatives de leurs activités et de prévoir de mesures de réparation ou de collaborer à leur mise en œuvre en cas d’atteintes aux droits de la personne. Or, le capitalisme de surveillance s’est développé en l’absence d’un cadre juridique contraignant et dans l’incertitude des obligations à la charge des entreprises opérant dans le domaine numérique.

Une nouvelle matière première

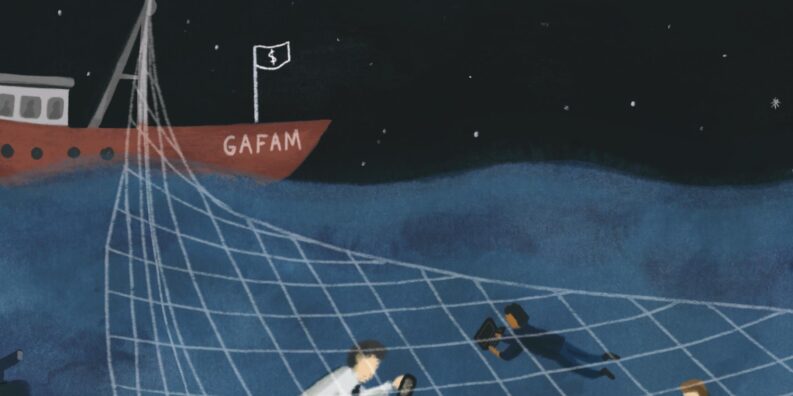

L’exploitation massive des données personnelles des utilisateurs a permis progressivement l’émergence d’un nouveau modèle de publicité ciblée en exploitant les informations de profils d’utilisateurs1, d’une redéfinition du consentement libre et éclairé des consommateurs face à des conditions générales d’utilisation complexes et d’un manque de transparence dans le traitement des données personnelles. La collecte de ces données sous couvert d’une utilisation gratuite et illimitée des services a permis la concrétisation d’un « nouvel ordre économique qui revendique l’expérience humaine comme matière première gratuite à des fins de pratiques commerciales dissimulées d’extraction, de prédiction et de vente2 ».

Les Nations Unies se sont emparées de la question en envisageant le droit à la vie privée à l’ère du numérique dans un rapport du Haut-Commissariat aux droits de l’homme (2018)3. Il a été souligné que les technologies numériques, mises au point principalement par le secteur privé, en exploitant en permanence les données personnelles, « pénètrent progressivement dans le tissu social, culturel, économique et politique des sociétés modernes ». Le rapport mettait également en garde contre l’émergence de cet « environnement numérique intrusif dans lequel les États et les entreprises commerciales seront en mesure de surveiller, d’analyser, de prédire et même de manipuler le comportement des personnes à un degré sans précédent » (§ 1).

Or, le capitalisme de surveillance s’est développé en l’absence d’un cadre juridique contraignant et dans l’incertitude des obligations à la charge des entreprises opérant dans le domaine numérique.

En ce qui concerne la responsabilité des entreprises de respecter le droit à la vie privée, le rapport recommandait aux États de se doter d’une législation adéquate et de mettre en place des autorités indépendantes en charge de surveiller les pratiques des secteurs public et privé, tout en leur accordant un pouvoir d’enquête sur les atteintes, la possibilité de recevoir des plaintes des particuliers ou d’organisations et d’imposer des amendes et d’autres sanctions effectives en cas de traitement illégal des données à caractère personnel (§ 61, points b), d) et e)).

Or, c’est précisément à l’égard de l’adoption de telles mesures que les États peinent à suivre le rythme effréné des innovations numériques et technologiques. Face aux lacunes du droit et à la lenteur des réformes législatives, les entreprises privées se trouvent investies d’un pouvoir démesuré, en l’absence d’une régulation stricte et d’un réel mécanisme de sanction en cas de violations des droits de la personne, dans un monde dématérialisé où la logique du profit, combinée à celle de la liberté numérique, ne connaissent aucune limite.

Dans une résolution adoptée le 7 octobre 2019, le Conseil des droits de l’homme des Nations Unies a réitéré les engagements des États et des entreprises en ce qui concerne le respect des droits de la personne dans le contexte de la collecte, du stockage, de l’utilisation, du partage et du traitement des données personnelles (§ 6 et § 8)4. Le plus récent rapport du Haut-Commissariat des Nations Unies aux droits de l’homme était consacré à l’« Incidence des nouvelles technologies sur la promotion et la protection des droits de l’homme dans le contexte des rassemblements, y compris des manifestations pacifiques » (2020)5.

En effet, l’impact des nouvelles technologies dépasse le cadre de la protection de la vie privée en ayant aussi des répercussions sur le droit de réunion pacifique et la liberté de manifester, notamment lorsqu’il est question des systèmes de reconnaissance faciale exploités par les entreprises privées et qui sont utilisés pour surveiller les activités des acteurs de la société civile (§ 39). Ce sont ainsi les fondements de la démocratie et les principes de l’État de droit qui peuvent être impactés par l’exploitation des données personnelles, comme cela a pu être le cas avec la société Cambridge Analytica qui a procédé à la collecte des données personnelles des utilisateurs de Facebook et utilisées à des fins politiques pour influencer l’issue des élections6.

Face aux lacunes du droit et à la lenteur des réformes législatives, les entreprises privées se trouvent investies d’un pouvoir démesuré, en l’absence d’une régulation stricte et d’un réel mécanisme de sanction en cas de violations des droits de la personne, dans un monde dématérialisé où la logique du profit, combinée à celle de la liberté numérique, ne connaissent aucune limite.

De multiples défis

Même en l’absence d’un instrument juridique contraignant destiné à réguler le capitalisme de surveillance, les principes protecteurs du droit international des droits de la personne sont susceptibles de contraindre les entreprises privées à se conformer à des standards minimums en matière d’exploitation des données personnelles. Les défis persistants et les difficultés qui paraissent incontournables découlent principalement de l’exploitation des données personnelles dans un environnement dématérialisé.

Dans ce cadre, l’identification d’un dommage demeure extrêmement complexe et l’engagement de la responsabilité des acteurs privés très largement hypothétique. Le décalage entre la rapidité des progrès technologiques et la lenteur de la réactualisation de l’encadrement juridique dans les ordres juridiques internes des États a entraîné l’émergence d’une économie de surveillance dans laquelle les données personnelles des utilisateurs sont la monnaie d’échange et la source infinie de profit pour les entreprises privées qui peuvent agir parfois en toute impunité.

Si ces entreprises sont tenues de respecter les droits humains dans le cadre de leurs activités, de leur toute-puissance numérique découle l’incapacité des États à les contraindre au respect de leurs obligations en engageant leur responsabilité assortie de véritables sanctions. Ce constat sera vrai aussi longtemps que les cadres juridiques nationaux ne seront pas dotés de mesures législatives appropriées et que les autorités étatiques ne seront pas habilitées à exercer un véritable pouvoir de contrôle de nature à imposer des limites et à contraindre les entreprises privées à une utilisation des données personnelles conforme aux garanties qui s’attachent aux droits et libertés.

Les défis persistants et les difficultés qui paraissent incontournables découlent principalement de l’exploitation des données personnelles dans un environnement dématérialisé.

Vers un premier traité international

Le défi majeur réside dans la capacité des États à imposer, isolément, un encadrement juridique aux acteurs privés qui reposerait uniquement sur le droit interne, alors même que le multilatéralisme et la coopération globale semblent incontournables afin de répondre adéquatement à cette problématique.

Si un traité international véritablement contraignant serait plus approprié, il serait nécessaire que les négociations aboutissent tout d’abord et qu’il recueille un nombre suffisant de ratifications de la part des États qui s’engageraient à une mise en application effective au niveau national grâce à la modification de leur cadre législatif. Dans le cadre du Conseil de l’Europe, des négociations devraient commencer au mois de mai 2022 en vue d’aboutir à l’adoption d’un texte contraignant sur l’intelligence artificielle7. Il s’agirait du premier traité international, mais si le texte venait à être adopté, il pourrait réunir au maximum 46 États (à la suite de la récente exclusion de la Russie du Conseil de l’Europe qui sera effective en septembre 2022).

Parallèlement, un projet de règlement sur l’intelligence artificielle8 a été proposé par la Commission dans le cadre de l’Union européenne en avril 2021. Il faudra suivre les développements de ce processus, qui pourrait aboutir à une législation harmonisée sur l’intelligence artificielle et qui serait immédiatement applicable dans les 26 États membres de l’Union. En ce qui concerne les Nations Unies, si des négociations n’ont pas encore été initiées en vue de l’adoption d’un texte contraignant, un moratoire a été demandé sur l’utilisation de certains systèmes d’intelligence artificielle9 face aux risques de violations graves des droits de la personne.

Dans le cadre de l’UNESCO, la première norme mondiale sur l’éthique de l’intelligence artificielle a été adoptée par 193 États au mois de novembre 202110. Bien qu’il ne s’agisse pas d’un texte ayant une force obligatoire, les États ont une responsabilité de principe dans la mise en œuvre des recommandations. Ainsi, pour l’instant, au niveau universel, des instruments de droit souple (soft law) définissent des principes qui ne sont pas juridiquement contraignants, mais qui pourraient servir de guide aux autorités nationales dans la détermination de mécanismes de protection et la réactualisation des législations.

- En ligne : https://www.monde-diplomatique.fr/2019/01/ZUBOFF/59443

- En ligne : https://www.lapresse.ca/societe/2020-12-06/notre-droit-au-temps-futur.php

- En ligne : https://www.ohchr.org/fr/calls-for-input/reports/2018/report-right-privacy-digital-age

- En ligne : https://documents-dds-ny.un.org/doc/UNDOC/GEN/G19/297/53/PDF/G1929753.pdf?OpenElement

- En ligne : https://www.ohchr.orghttp://www.ohchr.org/fr/documents/thematic-reports/ahrc4424-impact-new-technologies-promotion-and-protection-human-rights

- En ligne : https://ici.radio-canada.ca/nouvelle/1090159/facebook-cambridge-analytica-donnees-personnelles-election-politique-campagne- marketing-politique

- En ligne : https://justice.legibase.fr/actualites/veille-juridique/actualite-de- la-regulation-internationale-de-lintelligence-artificielle-123050

- En ligne : https://eur-lex.europa.eu/legal-content/FR/ ALL/?uri=CELEX:52021PC0206

- En ligne : https://news.un.org/fr/story/2021/09/1103762

- En ligne : https://news.un.org/fr/story/2021/11/1109412